“Escolas de Nova York proibiram o uso de um aplicativo de inteligência artificial que consegue até escrever redações para os alunos” (Escolas […], 2023, 00:01s-00:09s). Essa foi a primeira notícia sobre a IA generativa transmitida nacionalmente pela maior rede de televisão do nosso país. Ela é emblemática da preocupação de docentes e gestoras/es, da reação ao medo do desconhecido, da resistência à mudança.

“O que parece ser o maior sonho de qualquer estudante é o maior pesadelo das escolas. […] Os professores lutam para descobrir como evitar trapaças por parte dos estudantes” (Escolas […], 2023, 00:23-01:05). De fato, não há aprendizagem nem desenvolvimento das capacidades intelectuais quando um/a estudante utiliza a IA para gerar respostas às atividades didáticas sem se envolver ativamente no processo de elaboração e sem refletir criticamente sobre os resultados. Isso resulta em um sentimento de autoria prejudicada e baixa atividade neural (Kosmyna et al., 2025), um desperdício da oportunidade de formação, uma trapaça acadêmica.

Contudo, quando a redação é elaborada pela/o própria/o estudante e só depois ela/e utiliza a tecnologia generativa para revisar e aprimorar o texto, observa-se um sentimento de autoria forte e uma atividade neural mais intensa. Nessa situação, a IA generativa torna-se uma aliada no processo de aprendizagem e desenvolvimento da escrita. Essas são as conclusões de uma importante pesquisa científica sobre a atividade cerebral durante o processo de escrita de redações, que constatou que o momento estratégico para usar uma tecnologia de IA generativa é após um esforço inicial autônomo de redação sem uso de tecnologias digitais, pois isso aumenta o engajamento e a integração neural (Kosmyna et al., 2025). Um mês após terem proibido o uso de IA nas escolas de Nova York, mudaram a decisão: “NY derruba proibição ao ChatGPT e passa a incentivar IA nas escolas” (Possa, 2023).

As/Os estudantes utilizam as tecnologias generativas de maneiras diversas e inventivas, não apenas para que a IA realize a tarefa por elas/es. Essas tecnologias podem ser empregadas como apoio à pesquisa, ao estudo-aprendizagem e à cocriação, em um processo conversacional, interativo, de idas e vindas, que não configura trapaça acadêmica.

A possibilidade de estudantes utilizarem as respostas geradas por IA em atividades escolares e universitárias tornou-se uma preocupação recorrente entre docentes. Desde o lançamento do ChatGPT, passou a ser difícil afirmar se um texto ou atividade foi produzido por um/a estudante ou por uma tecnologia generativa, uma vez que os conteúdos gerados computacionalmente são cada vez mais coerentes, informativos e, por vezes, indistinguíveis dos textos humanos. Diante dessa dificuldade, foram desenvolvidos os chamados “detectores de IA”: sistemas computacionais projetados para identificar se um texto foi gerado por uma IA ou escrito por uma pessoa.

Textos gerados por IA costumam ser originais, o que inviabiliza sua detecção por meio da comparação com documentos existentes, que é o método empregado pelos sistemas tradicionais de identificação de plágio. Para contornar essa limitação, os detectores de IA adotam outra estratégia: analisam características textuais que podem indicar autoria artificial, como padrões estilísticos, recorrência de determinadas palavras e estruturas linguísticas, além da ausência de erros gramaticais e ortográficos. No entanto, esses sistemas podem falhar: um texto escrito por uma pessoa pode ser erroneamente classificado como gerado por IA (falso positivo), assim como um texto gerado por IA pode ser identificado como humano (falso negativo).

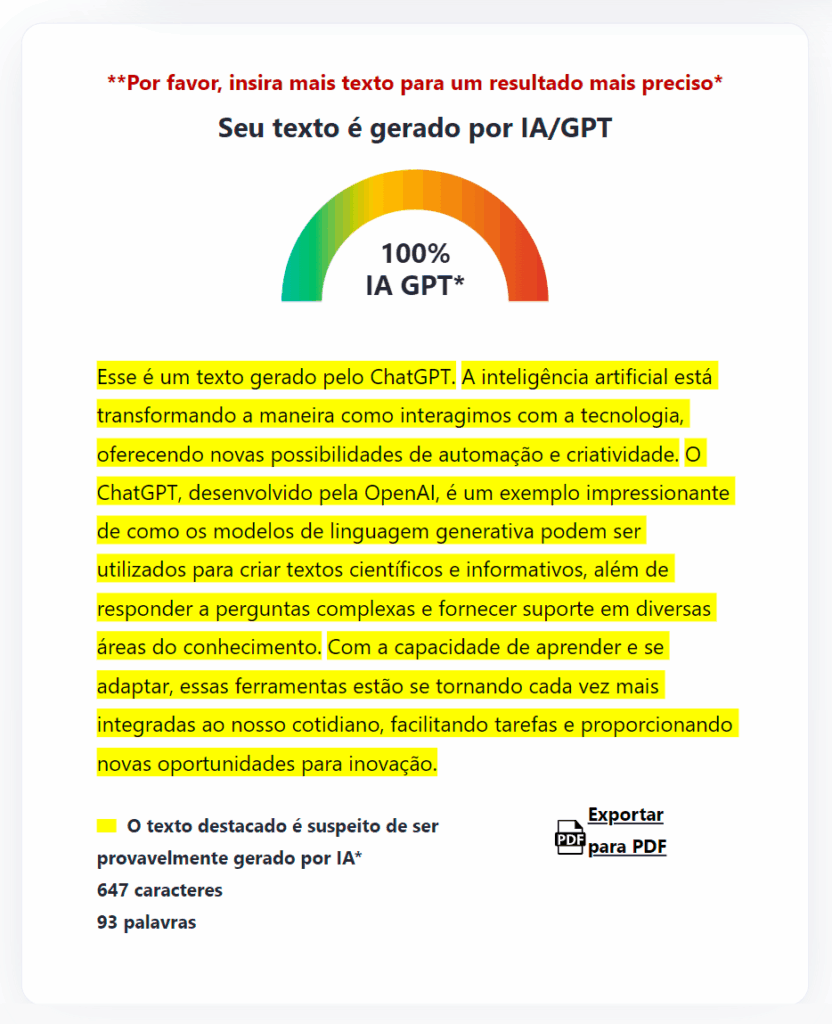

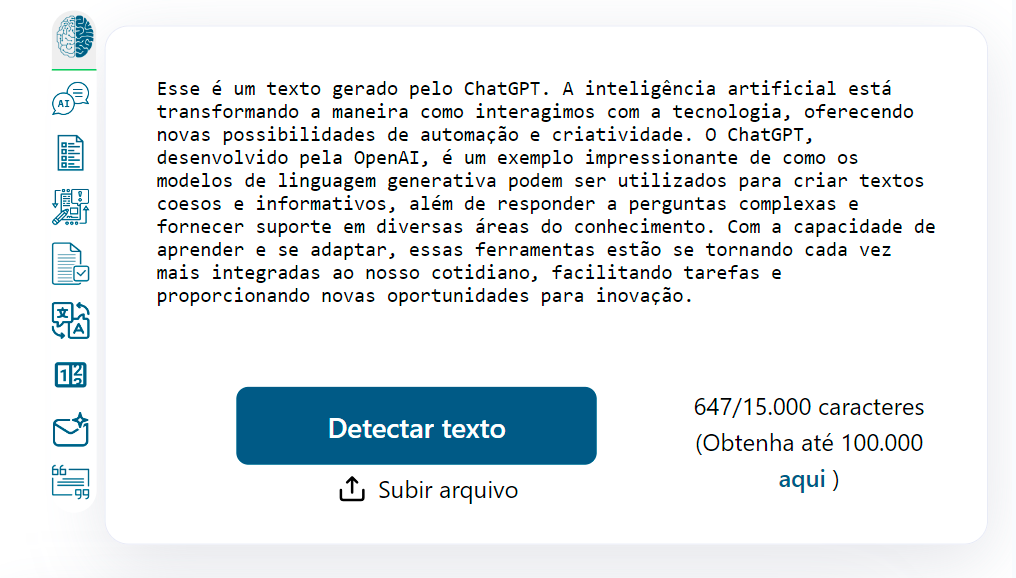

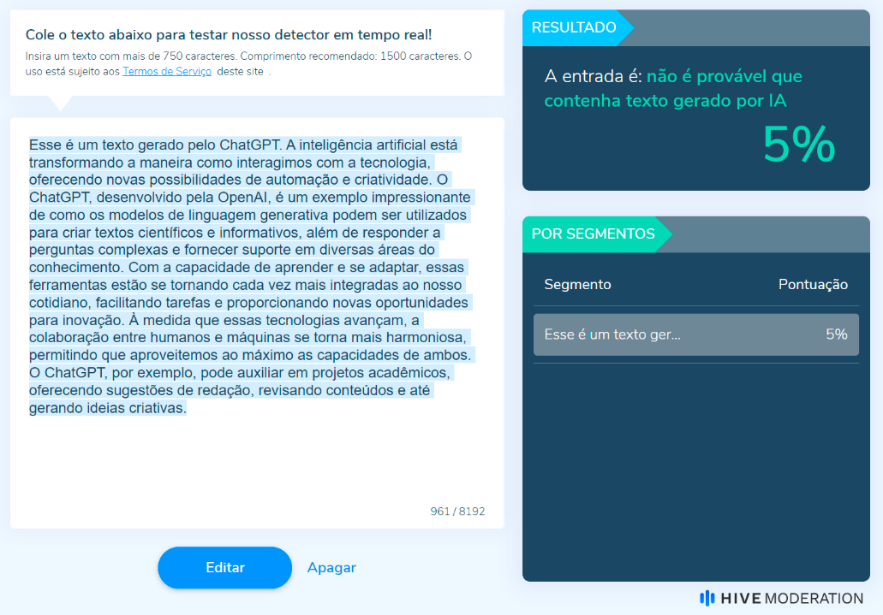

A seguir, apresentamos a análise de alguns detectores de IA aplicada a um texto gerado pelo ChatGPT. Dois detectores identificaram corretamente que o texto havia sido gerado por IA, enquanto um terceiro o classificou equivocadamente como sendo de autoria humana.

Fonte: ZeroChat

Fonte: Scribbr

Fonte: Hive

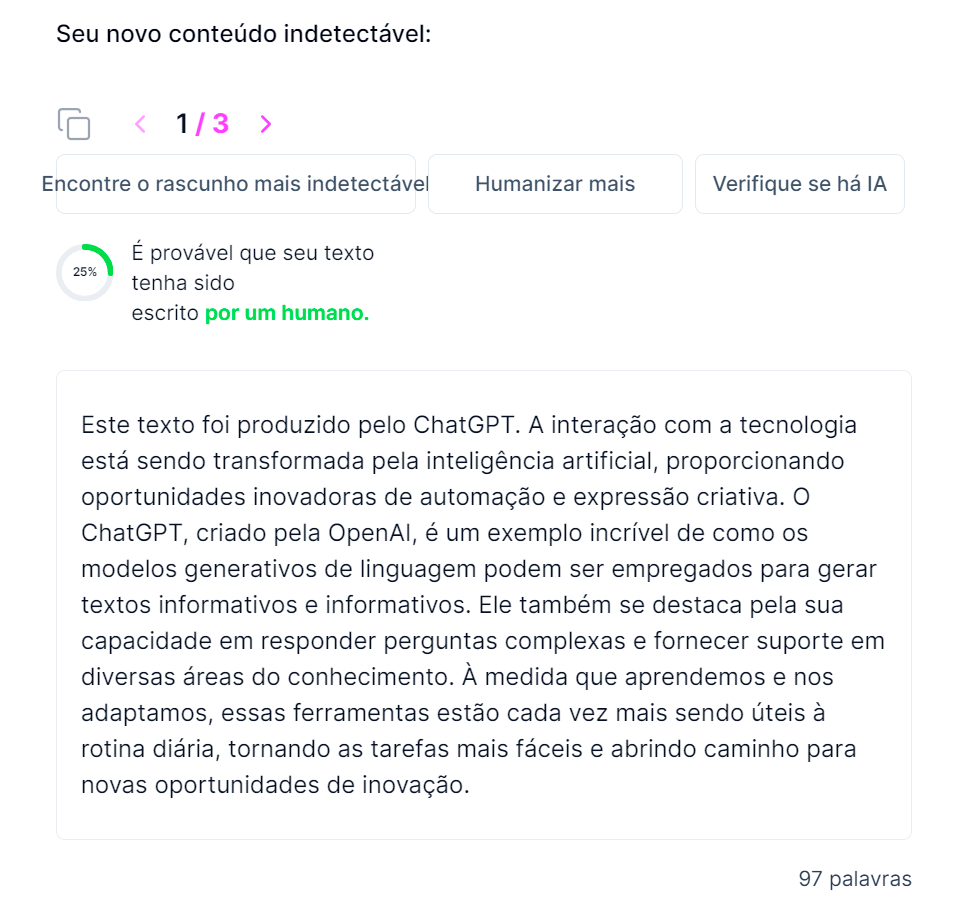

Com a popularização dos detectores de IA, foram desenvolvidos sistemas para “humanizar” textos gerados por IA. Esses sistemas modificam o texto com o objetivo de enganar os detectores, introduzindo propositalmente alguns erros e alterando o estilo de escrita, o tom e a fluidez da redação. Como resultado, um texto “humanizado” pode ser erroneamente classificado pelos detectores como de autoria humana. Utilizamos um desses sistemas de humanização para modificar o texto gerado pelo ChatGPT, e, de fato, o novo texto gerado foi classificado como “escrito por um humano”. A conclusão é que a detecção de textos gerados por IA é falível e pode ser facilmente enganada com o uso de sistemas que “humanizam” o conteúdo.

Fonte: Stealthwriter.AI

Concordamos com a afirmação: “Não tente detectar a IA — faça com que o uso da IA não seja o problema” (MIT[…], 2023). Nós, educadoras/es, precisamos ensinar quando e como usar a IA, em vez de proibir seu uso e punir quem a utiliza. Afinal, não é possível manter a educação como era antes da sua chegada. Devemos, sim, repensar as práticas educativas. Em nossos cotidianos formativos, partimos do pressuposto de que toda atividade assíncrona será realizada com o apoio de tecnologias generativas, por isso iniciamos nossas propostas de atividades com a seguinte orientação: “Usando a IA generativa, faça…”. Também criamos atividades que não podem ser realizadas exclusivamente por IA, valorizando a subjetividade de cada estudante, suas histórias de vida e de formação, os acontecimentos que marcaram suas trajetórias, suas formas singulares de compreender o mundo, seus sentimentos, desejos, medos, ideologias e demais facetas de suas identidades únicas.

Em nosso tempo de escola, nas remotas décadas de 1980 e 1990, nossas mães nos ensinaram a fazer os trabalhos copiando trechos de enciclopédias físicas. Torcemos para que, hoje, as atividades escolares não possam ser realizadas simplesmente copiando um texto pronto, seja de uma enciclopédia digital ou de outras fontes da internet, nem que possam ser feitas por uma IA que pouco ou nada conhece sobre sua/seu usuária/o. Talvez a popularização das tecnologias generativas venha a impulsionar uma transformação necessária nas práticas didático-pedagógicas e nos currículos escolares e universitários.

Precisamos educar para um uso da IA generativa que seja ético (não plagiar), estético (criar com sensibilidade e estilística própria) e político (formar sujeitos críticos). A ética é um tema central neste cenário à medida que as inovações computacionais vêm transformando as formas de produção do conhecimento, do seu compartilhamento e do acesso a ele. A integração das tecnologias digitais ao processo educacional impõe desafios éticos que exigem atenção de educadoras/es e gestoras/es, especialmente no que se refere à capacidade de avaliar e discernir quando o uso da tecnologia é responsável e formativo, ou quando representa apenas uma forma de trapaça acadêmica. É urgente reinventar a didática para que possamos utilizar as tecnologias como aliadas da aprendizagem, sem cair em armadilhas que possam comprometer a integridade do sistema educacional.

As tecnologias digitais podem ser analisadas sob a perspectiva filosófica da estética. Tradicionalmente associada à apreciação do belo e ao estudo da arte, a estética é uma noção mais ampla e refere-se à experiência sensorial e afetiva que molda nossa percepção do mundo. Nas tecnologias digitais, a dimensão estética ultrapassa o design visual das interfaces computacionais; ela envolve a experiência vivida por estudantes e docentes ao interagirem com os dispositivos tecnológicos, referindo-se à maneira como a tecnologia afeta os modos de aprender, comunicar e pensar.

A dimensão política do uso das tecnologias digitais na educação é igualmente complexa e multifacetada, envolvendo questões de poder, controle, vigilância e acesso. Essa dimensão se articula com instituições educacionais, políticas estatais e dinâmicas do capitalismo. No campo da macropolítica, destacam-se pautas como inclusão digital, letramento para a IA, cibercidadania, proteção de dados, soberania digital, formação continuada de docentes para a apropriação pedagógica das tecnologias e outras questões que influenciam diretamente os processos de transformação social. Ao debatermos as tecnologias digitais em contextos educacionais, precisamos indagar quais são os interesses por trás dessas tecnologias e como elas podem contribuir para a promoção da justiça educacional e social.

Na micropolítica do cotidiano escolar, tomamos decisões a todo instante sobre como usar (ou não) as tecnologias em nossas práticas pedagógicas: se iremos utilizá-las para potencializar a aprendizagem ou se vamos tentar impedir seu uso. Do ponto de vista de estudantes, também há escolhas: se irão aprender com essas tecnologias ou usá-las para fazer por elas/es os deveres de casa que consideram despropositados ou enfadonhos. Essas decisões diárias, muitas vezes sutis e nem sempre visíveis, revelam nossas intenções e preferências, bem como o investimento que fazemos na nossa própria formação e, em última instância, nossas concepções de mundo.

A popularização das tecnologias generativas desafia a educação tradicional e abre possibilidades para a reinvenção das práticas didático-pedagógicas. Educar para o uso ético, estético e político dessas tecnologias, apoiando estudantes a refletirem sobre elas, e delas se apropriarem de modo formativo, é um compromisso que devemos assumir na preparação de uma geração que já utiliza a IA generativa cotidianamente.